Rozpoznawanie emocji

Następny krok w tworzeniu wirtualnych postaci i światów. Gry od zawsze dostarczały emocji. Ale jeszcze nigdy wcześniej, gra nie była w stanie reagować na emocje gracza! Dopiero teraz jest to możliwe, dzięki naszemu rozwiązaniu.

Emocje i gry

Gry zawsze kojarzymy z emocjami. Wywołują one określone emocje gracza w sposób często niedostępny innym mediom. Jednocześnie do tej pory nie były one w stanie w pełni wejść w interakcję z graczem, nie będąc w stanie rozpoznać jego emocji.

Dzięki naszemu rozwiązaniu, postaci NPC czy też mechaniki gry, będą mogły reagować inaczej w zależności od emocji gracza. Można dostosować poziom trudności na bazie frustracji lub złości gracza, a postać NPC zachowa się wobec nas inaczej gdy będziemy nastawieni pogodnie i radośnie, a inaczej gdy będziemy nacechowani negatywnymi emocjami.

Wywoływanie emocji

Rodzaje emocji

Koło emocji

Sensory i emocje

Ruch ciała

Ruch głowy

Ruch gałek ocznych

Tętno

Ruchy ciała (w postaci rąk) i głowy dostępne są w ramach niemalże każdego zestawu gogli VR. Ruchy gałek ocznych wspierane są przez coraz większe grono gogli (producentów masowych takich jak m.in. Sony, HTC, Meta). Tętno odczytywalne jest przez popularne opaski (np. Garmin).

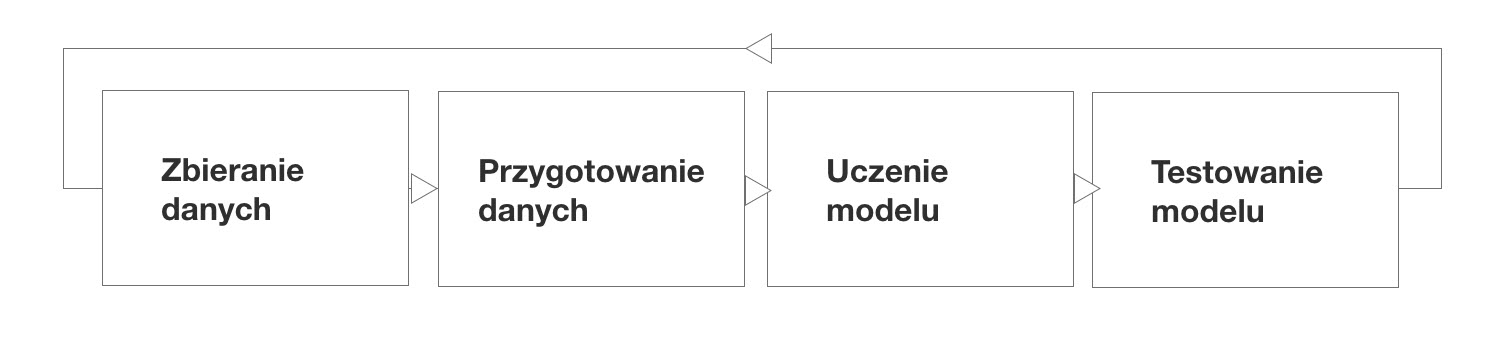

Sztuczna inteligencja na pomoc

Aby klasyfikować i rozpoznawać emocje gracza, wykorzystujemy algorytmy sztucznej inteligencji. Dzięki temu możemy wykrywać faktyczny stan emocji, w przeciwieństwie do wykrywania predefiniowanych gestów, lub przyjmowania założeń heurystycznych.

Model został wytrenowany na bazie przeprowadzonych laboratoryjnie badań. Tak wytrenowany model został dostosowany i przetestowany, by na końcu przybrać formę gotowego do użycia, zweryfikowanego rozwiązania.

Dostosuj do własnych potrzeb

Przygotowaliśmy rozwiązanie uniwersalne, ale możesz je dostosować do własnych potrzeb. Każda gra ma swoje potrzeby, dlatego dajemy pełną swobodę w wykorzystaniu rozwiązania.

Zdecyduj, jakie czujniki będziesz obsługiwać, jaką klasyfikację emocji chesz wykonać oraz dostosuj szczegółowe parametry i stwórz własne eksperymenty.

Czujniki

Liczba emocji

Parametry

Eksperymentuj

Dowiedz się pierwszy